La primera semana del juicio entre Elon Musk y Sam Altman ha capturado la atención del mundo tecnológico. Musk ha alegado que fue engañado por Altman y OpenAI al convertir a la organización, originalmente sin fines de lucro, en una empresa con fines de lucro. Esta transformación ha generado un debate intenso sobre la ética en el desarrollo de la inteligencia artificial y su impacto en la sociedad. Michelle Kim, nuestra corresponsal en el juicio, ha reportado sobre las tensiones en la sala del tribunal y ha desglosado momentos clave, desde declaraciones explosivas hasta los sutiles matices de la relación entre Musk y Altman, lo que establece un precedente para futuros litigios en la obra de IA.

En un momento en que la IA se convierte en la herramienta principal de formación de opiniones y de participación cívica, un grupo de expertos, liderado por Andrew Sorota y Josh Hendler, está abogando por un enfoque que utilice la inteligencia artificial para fortalecer la democracia. La polarización y el declive del compromiso cívico son temas candentes en la actualidad, y los diseñadores de IA tendrán la responsabilidad de forjar herramientas que fomenten el diálogo y la colaboración, en lugar de exacerbar tensiones existentes. En su informe, presentan un plan para transformar la forma en que se integra la IA en la vida política y cómo puede usarse para involucrar a los ciudadanos en el proceso democrático, promoviendo así un futuro más inclusivo.

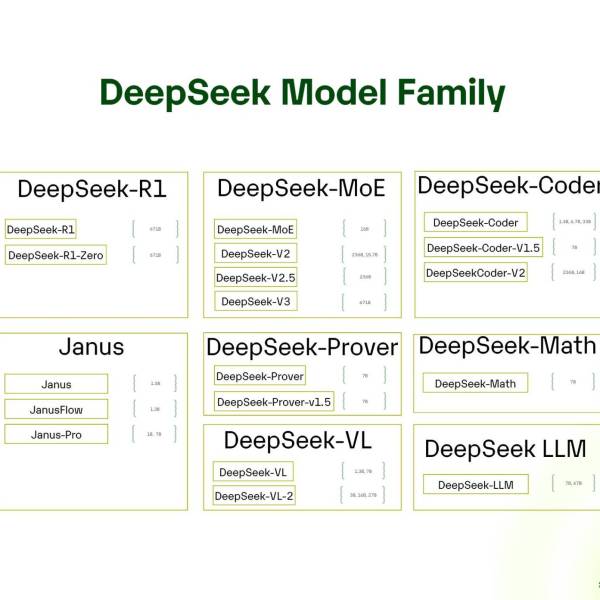

La creación de «científicos artificiales» es otra tendencia emergente que puede transformar la investigación científica. Los grandes modelos de lenguaje están siendo utilizados no solo para redactar artículos, sino también para participar activamente en proyectos de investigación. A medida que estos sistemas se desarrollan, existe un potencial significativo para mejorar la eficiencia del trabajo científico, pero también un riesgo de que se reduzca el papel de los investigadores humanos. La discusión sobre la responsabilidad y ética de estos sistemas se vuelve cada vez más relevante, pues la necesidad de mantener la creatividad y el juicio humano, que son esenciales en la ciencia, está en el centro de este dilema.

El Pentágono ha sellado acuerdos con gigantes tecnológicos para la implementación de inteligencia artificial en operaciones clasificadas, buscando construir un ejército de «primero IA». Los contratos con empresas como Microsoft, Nvidia y AWS subrayan una tendencia creciente hacia la militarización de la IA y la necesidad de que el sector privado se adapte rápidamente a la demanda del gobierno estadounidense. Esta relación plantea inquietudes sobre la privacidad de los datos y la gestión ética de la información clasificada, y deja a otras empresas, como Anthropic, en una posición precaria en el competitivo ámbito de la IA. Las implicaciones de estos acuerdos podrían cambiar radicalmente la forma en que se desarrollan y utilizan las tecnologías en el contexto militar.

El juicio entre Musk y Altman, junto con los recientes movimientos del Pentágono, son reflejos de una era en la que la inteligencia artificial está intersecando cada vez más con nuestras estructuras sociales, políticas y económicas. Desde el potencial de la IA para mejorar la democracia hasta los riesgos asociados con su uso militarizado y su impacto en la investigación científica, es evidente que estamos en una encrucijada. La ética y la regulación de la IA se están convirtiendo en temas cruciales que determinarán el futuro de nuestras sociedades, lo que requerirá un diálogo continuo y reflexivo entre legisladores, desarrolladores de tecnología y el público en general.