En la actualidad, la IA está transformando la forma en que experimentamos la inseguridad y el crimen cibernético. Con el auge de herramientas como ChatGPT, los delincuentes han comenzado a aprovechar la capacidad de la IA generativa para realizar estafas cada vez más sofisticadas. Desde correos electrónicos phishing elaborados que parecen auténticos hasta la creación de deepfakes que engañan a las personas, la IA ha democratizado el acceso a técnicas de engaño que antes requerían habilidades avanzadas. Organizaciones alrededor del mundo están luchando para contener esta creciente ola de ciberataques, y cabe preguntarse cómo las empresas van a adaptarse a esta nueva realidad donde las amenazas son más rápidas y difíciles de detectar.

A medida que las estafas potenciadas por IA se vuelven más prevalentes, las instituciones deben desarrollar mejores estrategias de defensa. Esto implica no solo la implementación de software de seguridad más avanzado, sino también la educación continua de los empleados para reconocer señales de alarma en comunicaciones electrónicas. Los especialistas en ciberseguridad advierten que la combinación de la inteligencia humana con herramientas automatizadas podría ser la clave para combatir esta nueva era de delitos cibernéticos. Sin embargo, la falta de protocolos estandarizados en la detección de estos nuevos tipos de ataques complica la respuesta a estas amenazas.

Paralelamente, la intersección de la inteligencia artificial y la salud ha comenzado a despertar tanto esperanza como escepticismo. El uso de IA para mejorar los procesos médicos, como el análisis de datos de pacientes y la interpretación de imágenes médicas, promete aumentar la eficiencia y precisión en la atención. A pesar de estos avances, existe una preocupación creciente sobre si estas herramientas realmente están mejorando los resultados de salud para los pacientes, ya que muchos estudios son preliminares. Las opiniones en el sector médico están divididas; mientras algunos creen que la IA es una solución valiosa, otros advierten sobre la necesidad de validación rigurosa antes de implementar estos sistemas de manera generalizada.

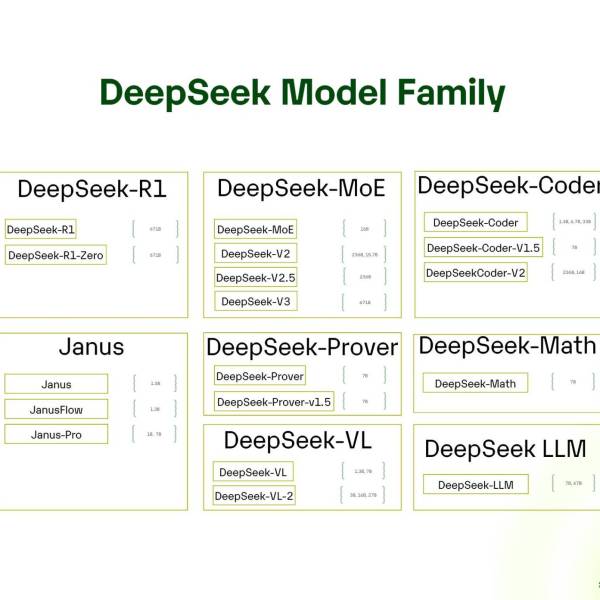

El reciente lanzamiento de DeepSeek-V4 marca un hito significativo en el desarrollo de IA, ya que se presenta como una de las plataformas de código abierto más potentes hasta la fecha. Este modelo, optimizado para aprovechar la tecnología de chips de Huawei, promete rivalizar con los avances de los gigantes de la industria, como OpenAI y DeepMind. A medida que estas tecnologías emergen, las empresas deben considerar cómo pueden utilizar los nuevos modelos de IA para mejorar sus ofertas, sin comprometer la seguridad o ética en sus operaciones. La presión para generar resultados y justificar el gasto en tecnología de IA está llevando a muchas organizaciones a reevaluar sus estrategias en el manejo de datos y la privacidad del usuario.

Sin embargo, el entorno actual está cargado de incertidumbre, ya que los debates sobre el uso ético de la IA se intensifican. A medida que algunos países implementan restricciones sobre el acceso de los jóvenes a las redes sociales y la IA, se plantea la necesidad de un marco regulatorio más robusto que proteja a los usuarios. La discusión sobre cómo la IA afecta la vida cotidiana y la interacción social es fundamental para definir el futuro de la tecnología. A medida que empresas continúan invirtiendo en IA en todas las áreas, la sociedad debe permanecer vigilante para garantizar que estas herramientas se utilicen con responsabilidad y para el bienestar general.